基于Spark NoSQL的實(shí)時(shí)數(shù)據(jù)處理實(shí)踐(下) 數(shù)據(jù)處理服務(wù)構(gòu)建與優(yōu)化

在上一部分探討了基于Spark與NoSQL數(shù)據(jù)庫的實(shí)時(shí)數(shù)據(jù)采集與存儲(chǔ)架構(gòu)后,本部分將聚焦于核心的數(shù)據(jù)處理服務(wù)。數(shù)據(jù)處理服務(wù)是整個(gè)實(shí)時(shí)流水線的大腦,負(fù)責(zé)將原始數(shù)據(jù)轉(zhuǎn)化為有價(jià)值的業(yè)務(wù)洞察。

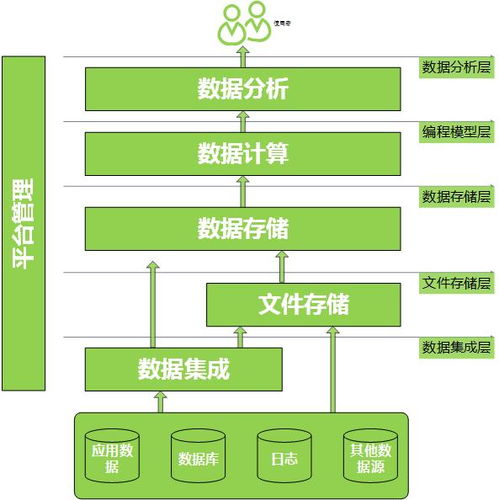

一、數(shù)據(jù)處理服務(wù)的核心架構(gòu)

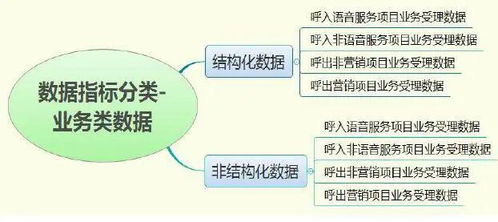

一個(gè)健壯的數(shù)據(jù)處理服務(wù)通常構(gòu)建于Apache Spark Streaming或Structured Streaming之上,并與NoSQL數(shù)據(jù)庫深度集成。其核心模塊包括:

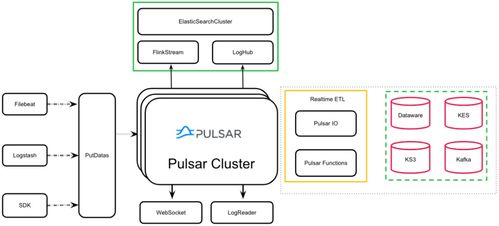

- 流數(shù)據(jù)接入層: 從Kafka、Pulsar等消息隊(duì)列中持續(xù)消費(fèi)原始數(shù)據(jù)流。利用Spark的

readStreamAPI,可以輕松對(duì)接多種數(shù)據(jù)源。 - 核心處理引擎: 這是服務(wù)的核心,利用Spark SQL、DataFrame API及用戶自定義函數(shù)(UDF/UDAF)實(shí)現(xiàn)業(yè)務(wù)邏輯。處理模式包括:

- 數(shù)據(jù)清洗與標(biāo)準(zhǔn)化: 過濾無效數(shù)據(jù)、解析復(fù)雜格式(如JSON嵌套)、統(tǒng)一數(shù)據(jù)編碼。

- 實(shí)時(shí)聚合與統(tǒng)計(jì): 基于滑動(dòng)窗口或滾動(dòng)窗口,計(jì)算每分鐘的訂單量、用戶活躍度等關(guān)鍵指標(biāo)。

- 事件模式匹配: 使用Spark的“狀態(tài)流處理”功能,檢測(cè)復(fù)雜的用戶行為序列(如“瀏覽-加入購物車-下單”)。

- 流-流/流-批Join: 將實(shí)時(shí)流與存儲(chǔ)在NoSQL中的維度表(如用戶畫像)或另一個(gè)流進(jìn)行關(guān)聯(lián),豐富數(shù)據(jù)上下文。

- 狀態(tài)管理與容錯(cuò): 利用Spark的檢查點(diǎn)(Checkpointing)機(jī)制和NoSQL(如Cassandra、HBase)的持久化能力,可靠地保存計(jì)算中間狀態(tài),確保Exactly-Once語義和故障后快速恢復(fù)。

- 結(jié)果輸出與服務(wù)層: 將處理結(jié)果寫回NoSQL數(shù)據(jù)庫(供下游查詢),或同步至OLAP系統(tǒng)、推送至實(shí)時(shí)儀表盤。可封裝為低延遲的RESTful或gRPC API服務(wù),直接供前端應(yīng)用調(diào)用。

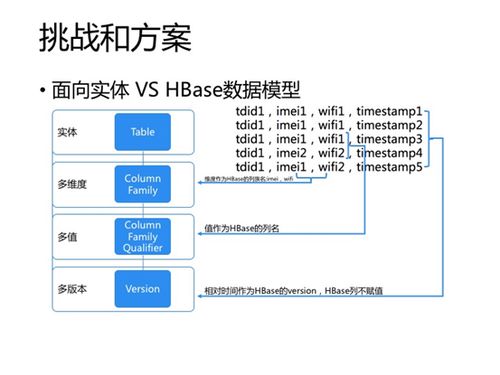

二、與NoSQL數(shù)據(jù)庫的協(xié)同實(shí)踐

- 作為維表(Lookup Table): 將HBase或Cassandra中的靜態(tài)/準(zhǔn)靜態(tài)數(shù)據(jù)(如商品信息、用戶資料)廣播或定期加載到Spark中,用于流數(shù)據(jù)的實(shí)時(shí)關(guān)聯(lián)查詢,極大提升處理效率。

- 作為結(jié)果存儲(chǔ)與狀態(tài)后端:

- 實(shí)時(shí)指標(biāo)存儲(chǔ): 將聚合結(jié)果(如計(jì)數(shù)器、排行榜)寫入Redis或Cassandra,利用其高性能讀寫特性,支撐實(shí)時(shí)查詢。

- 狀態(tài)持久化: 對(duì)于復(fù)雜的、需要跨批次維護(hù)狀態(tài)的應(yīng)用(如會(huì)話超時(shí)),可將狀態(tài)持久化到具備TTL功能的NoSQL中,由Spark進(jìn)行管理,增強(qiáng)系統(tǒng)的可擴(kuò)展性與可靠性。

- 使用Spark NoSQL Connector進(jìn)行高效讀寫: 利用為特定NoSQL優(yōu)化的連接器(如

spark-cassandra-connector、HBase-Spark),可以:

- 并行讀寫,充分利用集群資源。

- 下推謂詞過濾(Predicate Pushdown),減少不必要的數(shù)據(jù)傳輸。

- 自動(dòng)進(jìn)行分區(qū)映射,優(yōu)化數(shù)據(jù)本地性。

三、性能優(yōu)化與最佳實(shí)踐

- 微批處理與吞吐量調(diào)優(yōu): 合理設(shè)置Structured Streaming的觸發(fā)間隔(

trigger)和處理最大偏移量,在延遲與吞吐量之間取得平衡。 - 資源動(dòng)態(tài)分配: 結(jié)合Spark的動(dòng)態(tài)資源分配(Dynamic Allocation)功能,根據(jù)數(shù)據(jù)流量自動(dòng)調(diào)整Executor數(shù)量,實(shí)現(xiàn)資源高效利用。

- 序列化與數(shù)據(jù)結(jié)構(gòu)優(yōu)化: 使用Kryo序列化,并盡量使用Spark原生的

Dataset[Case Class]而非RDD,以利用Catalyst優(yōu)化器和鎢絲計(jì)劃(Tungsten)的二進(jìn)制內(nèi)存管理優(yōu)勢(shì)。 - 處理邏輯異步化: 對(duì)于需要調(diào)用外部服務(wù)(如風(fēng)控接口)的環(huán)節(jié),使用

mapPartitions結(jié)合異步HTTP客戶端,避免阻塞整個(gè)流水線。 - 監(jiān)控與告警: 密切監(jiān)控Spark UI中的批處理時(shí)間、調(diào)度延遲、背壓(Backpressure)指標(biāo),以及NoSQL的讀寫延遲。設(shè)置閾值告警,確保服務(wù)SLA。

四、典型應(yīng)用場(chǎng)景示例

以“實(shí)時(shí)反欺詐系統(tǒng)”為例:

- 交易流進(jìn)入Spark Streaming。

- 處理服務(wù)實(shí)時(shí)從Redis中查詢?cè)撚脩艚谛袨楫嬒瘢ňS表關(guān)聯(lián))。

- 基于規(guī)則引擎(可集成在UDF中)或簡(jiǎn)易的實(shí)時(shí)模型,對(duì)交易進(jìn)行評(píng)分。

- 將高風(fēng)險(xiǎn)交易實(shí)時(shí)寫入HBase供審核,并將用戶風(fēng)險(xiǎn)標(biāo)簽更新回Redis(狀態(tài)/結(jié)果存儲(chǔ))。

- 聚合統(tǒng)計(jì)各渠道的欺詐率,寫入Cassandra并同步至實(shí)時(shí)大屏。

###

構(gòu)建基于Spark NoSQL的實(shí)時(shí)數(shù)據(jù)處理服務(wù),關(guān)鍵在于充分發(fā)揮Spark在復(fù)雜流計(jì)算上的強(qiáng)大能力,同時(shí)利用NoSQL數(shù)據(jù)庫在靈活模型、高并發(fā)讀寫和持久化方面的優(yōu)勢(shì),實(shí)現(xiàn)兩者間的無縫協(xié)同與性能優(yōu)化。通過分層的服務(wù)設(shè)計(jì)、精細(xì)的狀態(tài)管理和持續(xù)的監(jiān)控調(diào)優(yōu),最終打造出穩(wěn)定、高效且能快速響應(yīng)業(yè)務(wù)變化的實(shí)時(shí)數(shù)據(jù)處理能力。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://www.qianyc.cn/product/76.html

更新時(shí)間:2026-04-09 06:38:24